이 논문은 비교적 최근 나온 XAI 관련 논문입니다. 본 논문은 모델 설명 방법론(eXplainable AI)에 대한 새로운 관점을 제시합니다. 연구자들은 다양한 모델 설명 방법을 제안했지만, 대부분의 방법들이 어떻게 서로 관련되어 있는지, 또 어떤 방법이 다른 것보다 우월한지에 대해 아직 명확하게 정의되지 않았습니다. 이 논문의 저자들은 이런 문제들을 해결하기 위해 'removal-based explanations'(제거 기반 설명방법)이라는 원칙에 집중합니다. 이 원칙은 모델에서 특정 Feature 집합을 제거하고 그 영향을 측정하는 것입니다.

저자들은 이 원칙을 기반으로 'removal-based explanations'이라는 프레임워크를 개발하였습니다. 이 프레임워크에 대해서 논문이 전개됩니다.

Paper

XAI와 관련해서 연구자들은 다양한 모델 설명 방법을 제안하였습니다. 하지만 대부분의 방법들이 어떻게 관련되어 있고 어떤 방법이 다른 방법에 비해 우수한지에 대해서는 아직 불분명합니다.

저자들은 문헌을 조사하고 많은 방법들이 '제거를 통한 설명' ( = removal-based explanations)이라는 공통의 원칙에 기반하고 있음을 발견하였습니다. 이는 본질적으로 모델에서 특징 집합을 제거하는 것의 영향을 측정하는 것입니다.

저자들은 'removal-based explanation'에 대한 프레임워크를 개발하였습니다.

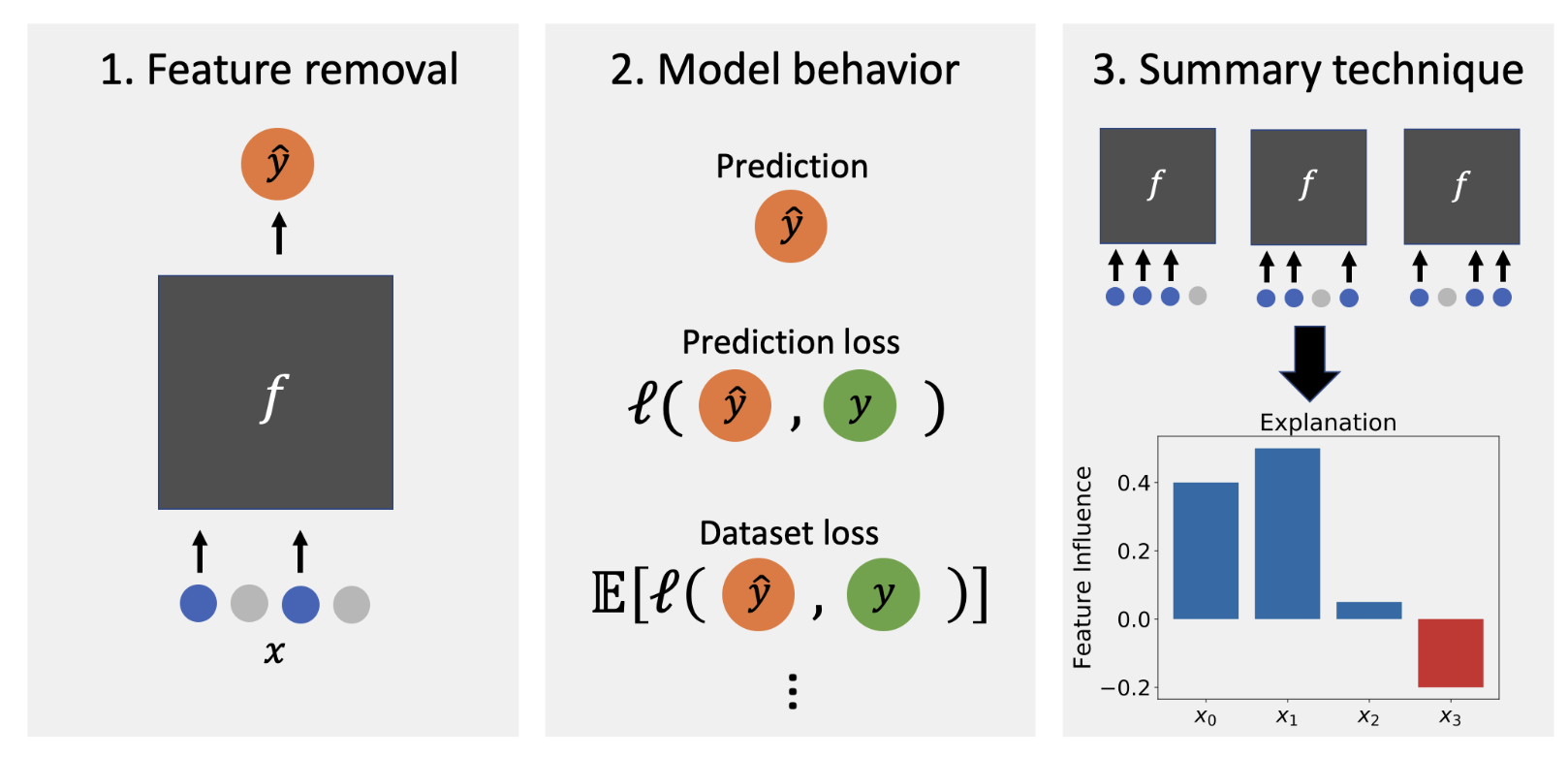

이 프레임워크는 세가지의 특징을 가지고 있습니다.

1. 방법이 특징을 어떻게 제거하는가

2. 방법이 어떤 모델 행동을 설명하는가

3. 방법이 각 특징의 영향을 어떻게 요약하는가

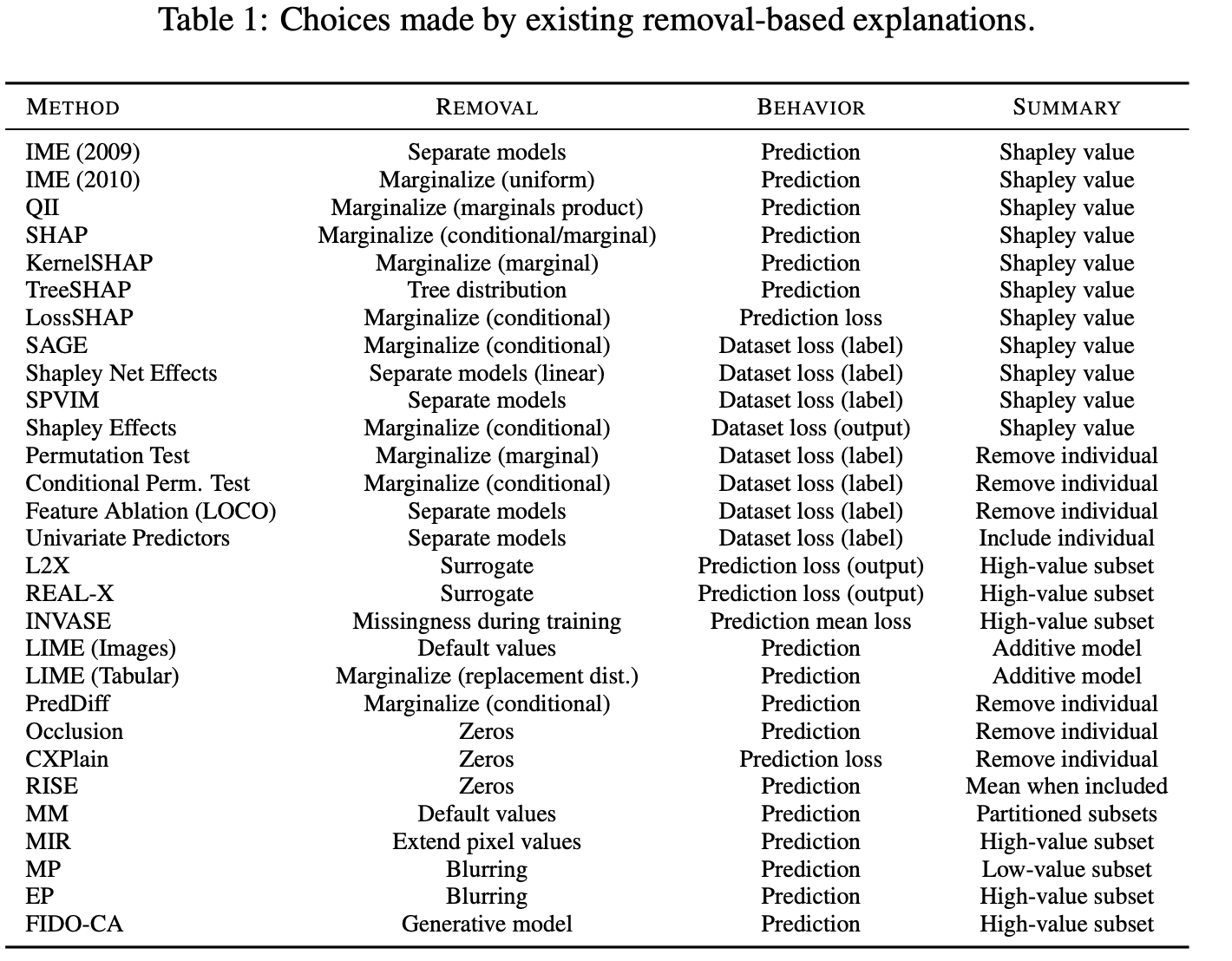

저자들이 기획한 프레임워크는 26개의 기존 방법들 ( SHAP , LIME, Meaningful Perturbations, 순열 검정) 등을 통합합니다.

이러한 방법들 사이에서 기본적인 유사성을 드러내는 것은 사용자들이 어떤 툴을 사용할지에 대해 생각할 수 있도록 도와줍니다.

논문에서는 계속 이전의 연구들이 Xai 모델들의 관계나 어느 방법론이 우월한지 조사하지 않았다고 언급합니다.

또한 인간의 복잡한 의사 결정 과정을 설명하는데 어려움이 있다고 주장합니다.

'Feature removal'에 대해서 방법론마다 상이한 접근 방식이 문제가 된다고 주장합니다.

저자들은 많은 방법들이 특징의 제거를 시뮬레이션하여 모델에 각 특징이 미치는 영향을 정량화하는 것을 기반으로 할 수 있다는 관찰을 바탕으로, 모델 설명 연구의 상당 부분을 통합하는 포괄적인 프레임워크를 제시합니다.

프레임워크의 특징에 관한 설명은 Abstract에서 언급했던 내용과 같습니다.

앞서 언급한 3가지 차원에 따라 각 방법을 특성화함으로써 저자는 다양한 방법 사이의 근본적인 유사성을 밝힐 수 있으며 모두 'Feature Removal'이라는 동일한 기본 접근 방식에 의존한다는 것을 보여줄 수 잇습니다. ( = Framework )

1. 저자들은 26개의 기존 설명 방법론을 통합하는 프레임워크를 제시하였습니다. 이 프레임워크는 제거 기반 설명을 위한 것으로 이전에는 서로 떨어져 있다고 간주되었던 방법들의 클래스를 통합합니다. 이는 로컬 및 글로벌 접근법이 포함되며 feature attribution 밒 feature selection method가 포함됩니다.

2. 새로운 수학적 도구개발 : 저자들은 기계 학습 모델에서 특징을 제거하는 다양한 접근법을 표현하기 위해 새로운 수학적 도구를 개발하였습니다. 부분집합 함수는 다양한 특징 제거 기법에 대한 공통의 표현을 제공하며, 이 선택이 방법들 사이에서 교환 가능함을 보여줍니다.

3. 다수의 설명 방법 일반화 : 저자들은 수많은 설명 방법을 일반화하여 개발한 프레임워크에서 표현하였습니다. 특히, 여러 접근법에 대해 저자들은 방법론들의 암묵적인 목표와 그것들을 실제로 사용 가능하게 하는 근사치들을 분리하였습니다.

머신러닝의 해석 가능성은 모델이 예측을 만드는 방식에 대한 insight 제공이 목적입니다.

새롭게 개발한 Framework가 제안하는 방향성.

저자들은 이전 연구들에 비해 훨씬 더 넓은 범위를 다루고 정확합니다. 저자들은 그들의 프레임워크가 세 가지 차원에 따라 방법들을 특성화한다고 합니다. Feature를 제거하는 방법을 세 차원에서 동시에 고려하고 단일 프레임워크 아래에서 통합하는 것은 이 논문이 처음이라고 밝힙니다.

이 논문에서 제시한 'Table 1: Choices made by existing removal-based explanations.' 은 'Removal-based explanations'(제거 기반 설명 방법)이 어떤 선택을 하는지를 나타냅니다. 특히 각 방법론이 어떻게 특징을 제거하는지, 어떤 모델 행동을 분석하는지 그리고 어떻게 각 특징의 영향을 요약하는지에 대한 정보를 제공합니다.

이러한 표는 연구자들이 다양한 방법들을 이해하고 비교하며 각 방법이 자신들의 특정 연구 문제에 어떻게 적용될 수 있는지 평가하는 데 도움이 됩니다.